Folge 190 „Wochniks Wochenende“: Musik & Künstliche Intelligenz – wer hat’s geschrieben?

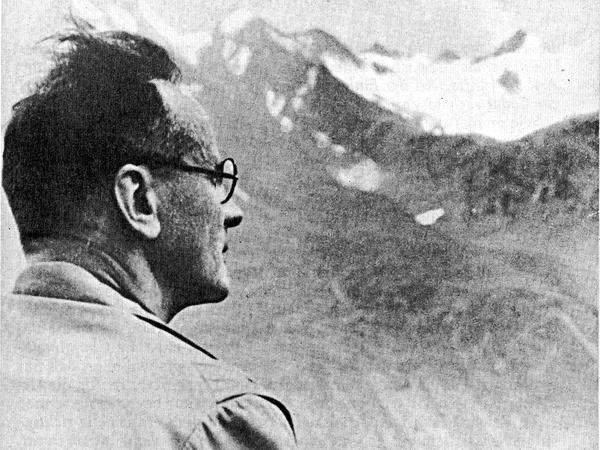

Dass er seine Komponistenhände andächtig vor dem selbst auferlegten Regelwerk zusammengefaltet habe, monierte Theodor W. Adorno am Schönberg-Mitschüler Anton Webern. Die Gefahr einer zur Universaltechnik überhöhten „stählernen Apparatur“ witterte er in der Zwölftontechnik, und darin die Tendenz zum Totalitären: Die Zwölftontechnik als totale Mechanisierung der Musik, sowohl was ihre Produktionsweise anging als auch in Bezug auf ihre gesellschaftliche Rolle.

Selbst ein Schüler und Anhänger Schönbergs, lag ihm nichts ferner als die Zwölftontechnik zu verteufeln. Vor der Tendenz zum Totalen zu warnen, war aber auch in seinen soziologischen Schriften Programm. Und ein mechanistisches Regelwerk, dem man die Musik gänzlich unterwarf, könnte, so schien ihm, auch die gesellschaftliche Neigung zur Totalität befördern.

Ein Jahrhundert lang Angst vor den Maschinen

Noch heute hört man Adornos Kritik des entmenschlichenden, maschinellen Musikmachens nachhallen, wenn es die vermeintlichen Gefahren Künstlicher Intelligenz auf die Musikwelt geht. Vor wenigen Tagen erst haben über 200 Künstlerinnen und Künstler einen besorgten Appell an KI-Unternehmen unterschrieben: Die Entwickler sollten sich freiwillig dazu verpflichten, heißt es darin, keine Technologie zu entwickeln oder einzusetzen, die die Kunst von Musikern und Songschreibern untergräbt oder ersetzt. Wieder geht die Sorge um, menschlicher Kreativität könnte etwas streitig gemacht werden. Es ist bei weitem nicht der erste Aufschrei der Kunstwelt in Sachen KI – nicht der letzten Jahre. Und nicht der letzten 100 Jahre.

© rororo

Was zu Weberns Lebzeiten (er wurde knapp zwei Wochen nach dem Krieg 1945 versehentlich von einem US-Soldaten erschossen) noch kaum jemand laut auszusprechen wagte, viele Komponierende aber längst ahnten, war der Verdacht, dass in Wahrheit aller Musik ein gewisser Grad der Automatisierung zugrunde lag. Genauer: dass alles das, was man als Eigenes, Wiedererkennbares an einer Musik erkennen kann, sich auf Formeln herunterbrechen lasse. Auch deshalb gingen viele Komponierende den Weg in immer weitere Untiefen der Formalisierung kompositorischer Verfahren, etwa in der seriellen Musik.

Dass Johann Sebastian Bachs Musik klang, wie sie klang, das wusste beispielsweise Karlheinz Stockhausen, lag an einem engen mathematischen Regelkorsett, das Bach selbst entwickelte und dem er sich dann fügte. Dessen er, wie wohl alle Komponierenden der Vergangenheit, sich aber nie bewusst war. Eben deshalb, betont Stockhausen, sei es möglich, alle Musik mithilfe der seriellen Methode zu analysieren, auch wenn sie in einem ganz anderen Geist geschrieben worden war.

Und: Serielle Musik zu schreiben, bedeutete, dieses bislang Unbewusste selbst zu komponieren, statt nur seine Oberfläche unterschiedlich zu verzieren. Computer waren dazu nicht zwingend notwendig, dennoch ließen Lejaren Hiller und Leonard Issacson schon 1957 den 1,8 Tonnen wiegenden ILLIAC I Computer der Uni Illinois das erste vollständig von einem Computer geschriebene Stück komponieren, die „Illiac Suite“, ein Streichquartett. Wohl weil das damalige Kunstverständnis zwingend einen Menschen als Urheber von Kunst verlangte, erregte sie in der Musikwelt kaum Aufsehen.

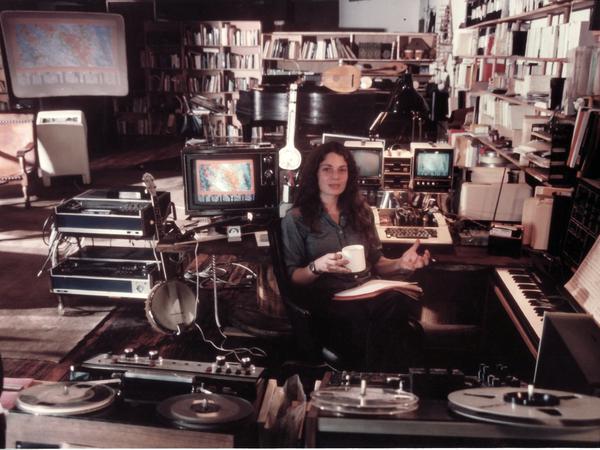

© Laurie Spiegel, 1982 © Apple II Studio, Foto: Enrico Ferorelli

Das kam erst, als der US-Komponist und KI-Forscher David Cope den empirischen Beweis für die auch alter Musik zugrunde liegende Formelhaftigkeit lieferte. Da er selbst nach eigener Aussage über keine erkennbare kompositorische Handschrift verfügte, habe er sich gefragt, was eine kompositorische Handschrift im Allgemeinen ausmache – auf mathematischer Ebene. Schon Anfang der Siebzigerjahre betrachtete er dafür die Personalstile anderer Komponierender, allen voran Johann Sebastian Bachs.

Wer hat’s komponiert?

Anfang der Achtzigerjahre war Cope schließlich so weit, der Welt eine Software vorzustellen, die neue Partituren im Stil Bachs automatisch generierte: EMI nannte er das System, Experiments in Musical Intelligence. Der Pulitzer-Preisträger Douglas Hofstadter, der in seinem 1979er-Preisträgerwerk, „Gödel, Escher, Bach“ bereits die Frage gestellt hatte, ob jemals eine Maschine in der Lage sein würde, erbauliche Musik zu schreiben, veranstaltete 1997 an der Stanford University einen geschichtsträchtigen Test. Pianistin Winifred Kerner trug drei Partituren vor: Ein so gut wie unbekanntes Originalwerk Johann Sebastian Bachs, ein im Bachstil komponiertes von Steve Larson (Musikprofessor an der Universität Oregon) und ein im Bachstil komponiertes vom EMI-System.

Das Publikum sollte im Hörtest erkennen, welches welches war und tippte zu Larsons Enttäuschung, dass das seine computergemacht war. Und dass, noch frappierender, das von EMI komponierte klar das Bachoriginal sein musste.

Da EMI außerdem längst nicht mehr nur dazu in der Lage war, Bach zu imitieren, sondern, in unterschiedlich überzeugenden Graden, auch Beethoven und Mozart, Chopin und Rachmaninoff, Strawinski und Joplin, ging jetzt ein Raunen durch die Musikwelt: EMI war nun nicht mehr nur irgendein Regelwerk, wie noch bei Webern. EMI war lernfähig, konnte so potenziell alle kopieren. Dem Betrug sei so Tür und Tor geöffnet, hieß es. Kein Mensch müsse mehr mühselig Note für Note setzen, wenn sich mit ausreichend großen Datenbanken, hinter denen entsprechende Algorithmen werkelten, alles automatisch komponieren ließe.

Weberns Klaviervariationen Opus 27 – auf die schaute Adorno als er Webern kritisierte – sind mittlerweile 88 Jahre alt, die älteste Computermusik, die Illiac Suite, 67 Jahre. Sie erschien im selben Jahr wie Elvis Presleys „All Shook Up“, 1957. Schon drei Jahre darauf erschien der erste wissenschaftliche Artikel über Künstliche Intelligenz in der Musik: „Eine algorithmische Beschreibung eines musikalischen Kompositionsprozesses“ von R. Kh. Zaripov. Wie Hiller und Isaacson komponierte in den Siebzigerjahren Laurie Spiegel algorithmisch an der Universität Illinois – 2023 erhielt sie den angesehenen Gigahertz-Preis für ihr Lebenswerk.

© University of Illinois Archives

Mit anderen Worten: Die Sorge darum, dass Technik kunstschaffenden Menschen das Wasser abgräbt, ist längst im Rentenalter. Als berechtigt hat sie sich bislang noch nicht erwiesen.

Ganz im Gegenteil: Bislang konnte nicht nur jede technische Entwicklung in die Produktion der Künste integriert werden, um Neues zu erschaffen – dass KI ein „enormes Potenzial als Werkzeug menschlicher Kreativität darstellt“, unterstreichen auch die Unterzeichner des aktuellen Appells. Nein, es gibt bekanntlich sogar noch heute Menschen, die, statt virtuell-immersive 3D-Laserlandschaften zu bauen, einfach Bilder malen oder mit dem Bleistift auf Papier Notenköpfe zeichnen – und die wird es aller Voraussicht nach auch noch lange geben.

Kann KI Künstler ersetzen?

Weil letztlich noch nie nur die technische Perfektion irgendeine Kunst ausgemacht hat. Sondern der intelligente, kunstvolle Einsatz von Techniken, alten wie neuen, mit Gespür für Zeit und Kontext. Damit im Kopf, nochmal der Blick auf die aktuellen Sorgen. Die kreisen speziell um einen auf den ersten Blick irritierenden Sprung der Technik. Mithilfe von KI lassen sich neuerdings nicht nur, wie schon seit langer Zeit, Komponierstile, sondern jetzt auch die Stimmen von Sängerinnen und Sängern klonen, sowie, in immer besserer Qualität, ihre äußere Erscheinung für Musikclips.

Dass diese unaufgeforderte Annäherung fremder Technik an den eigenen Körper viele zunächst verunsichert, ist nachvollziehbar. Dass aber ein TikTok-Nutzer namens Ghostwriter977 letztes Jahr großen Erfolg mit einem Song feierte, den er mit geklonten Stimmen von Drake und The Weeknd bastelte, ist wohl kaum ein Zeichen dafür, dass Drake und The Weeknd befürchten müssten, durch KI ersetzt zu werden.

Der Erfolg rührt schlicht von der Sensation, die ein solcher offenkundiger Fake ausmacht, was auch die Kommentare zum Clip belegen: Die drehten sich nämlich fast ausnahmslos um die Technik. Das heißt, man will es sich anhören, um kurzweilig zu staunen. Den Fake-Song, anstelle eines Drake oder The Weeknd Albums, hat wahrscheinlich niemand je aufgelegt. Und wird es in Zukunft erst recht nicht, denn, ist die Sensation einmal verbraucht, bleibt nicht viel Substanz zurück. Dieses Substanzielle zu liefern, das wird auch in Zukunft die Aufgabe von Kunstschaffenden sein, die ihnen keine KI so schnell wird streitig machen können. Ganz abgesehen von der wohl unbestreitbaren Tatsache, dass sich Menschen immer noch am meisten für Menschen interessieren.

Das erkannte übrigens auch Adorno schon, als er einige Jahre nach seiner frühen Kritik an Webern, denselben kennengelernt hatte. An Alban Berg schrieb er, Anton Webern sei „ein wunderbarer Mensch, von einer Art, wie es wirklich heute kaum welche gibt, und so unerhört substanziell und echt, daß gewisse Bindungen, die er hat, tatsächlich gar keine Rolle spielen. Und welch ein Künstler!“

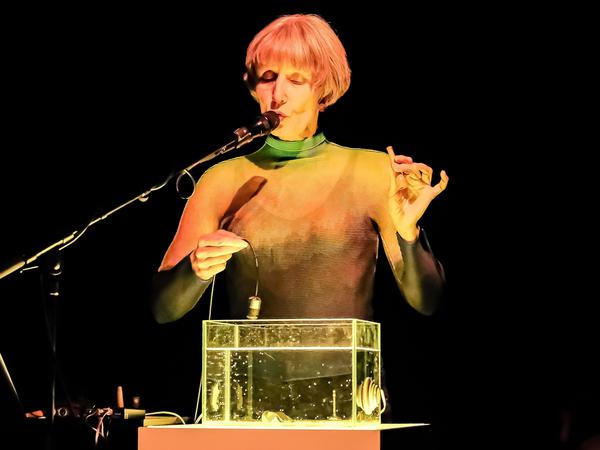

© Cristina Marx/Photomusix

Zum Schluss, der Serviceteil: Nachdenken über, wie es im Programm heißt, „Verflechtungen des Menschen mit einer intelligenten Umwelt, die die Intelligenz von Tieren, Pflanzen und Maschinen umfasst“, kann man dieses Wochenende wunderbar bei der Sound-Performance von Merche Blasco, Marina Cyrino und Ute Wassermann am Sa. 6.4., 20:30 im Morphine Raum, Köpenickerstraße 147 in Kreuzberg. Eintritt 10 Euro.